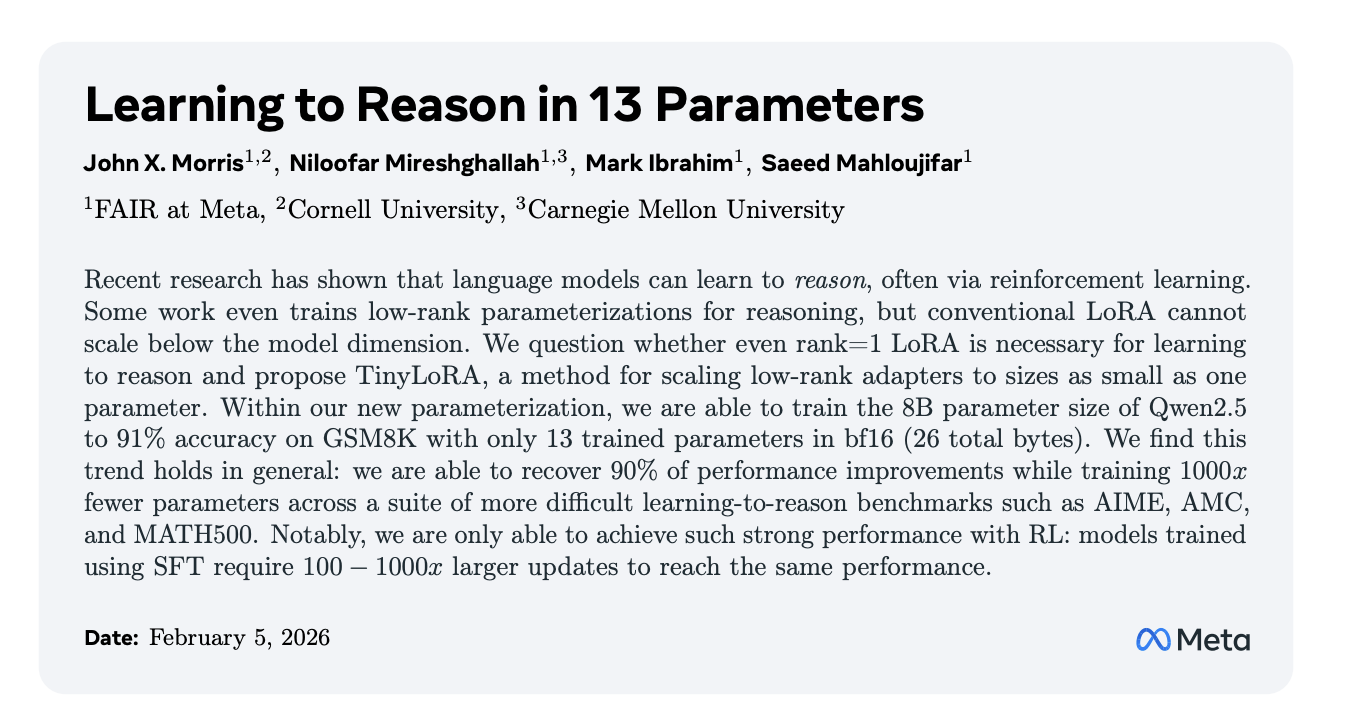

Advisor Strategy 里最难实现的是弱模型的「自知之明」

4 月 9 号,Anthropic 发了个特别的功能 Advisor Strategy。

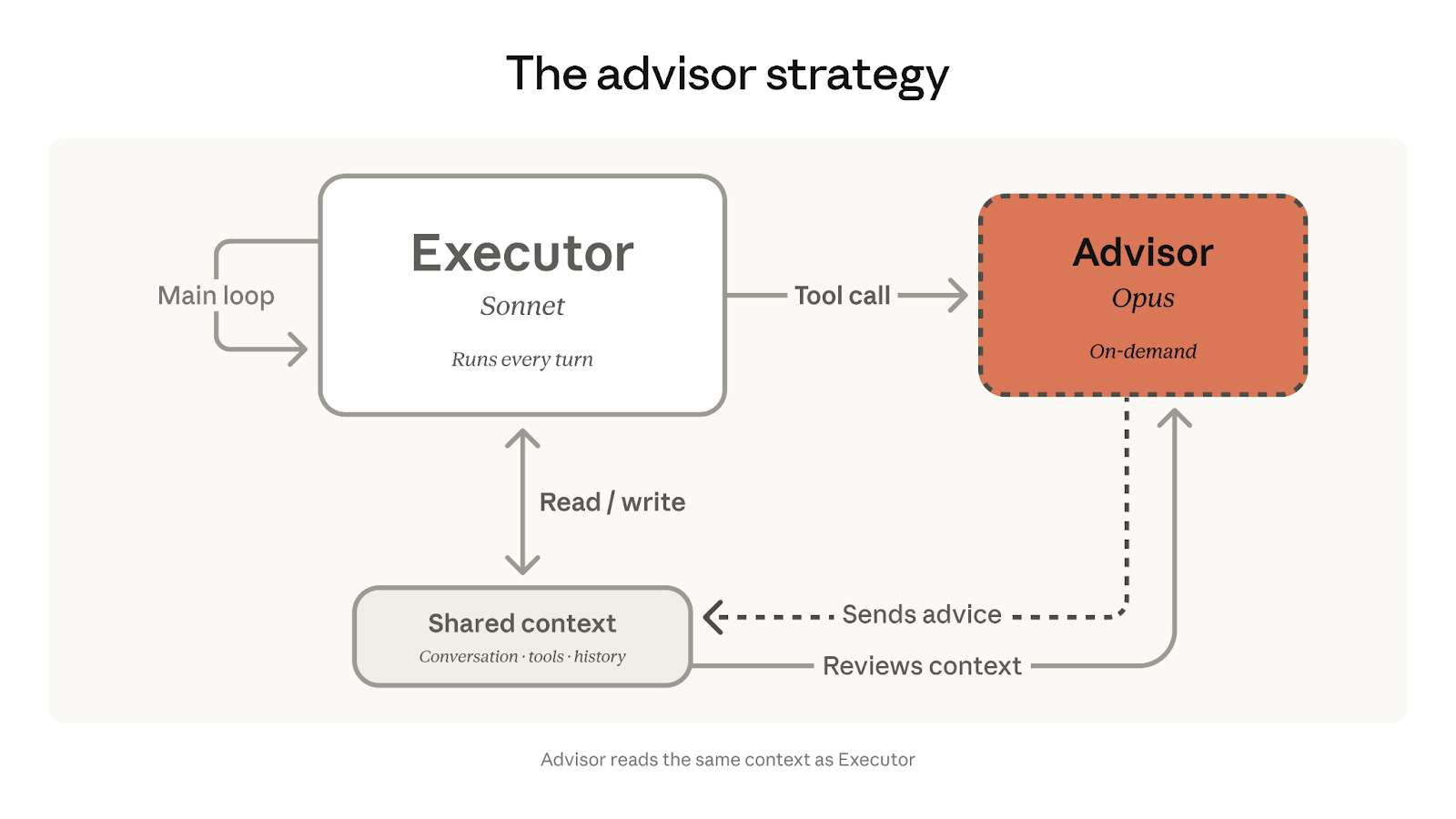

让学生姜维 Sonnet 或 Haiku 先跑任务,遇到搞不定的再请诸葛亮 Opus 出山。

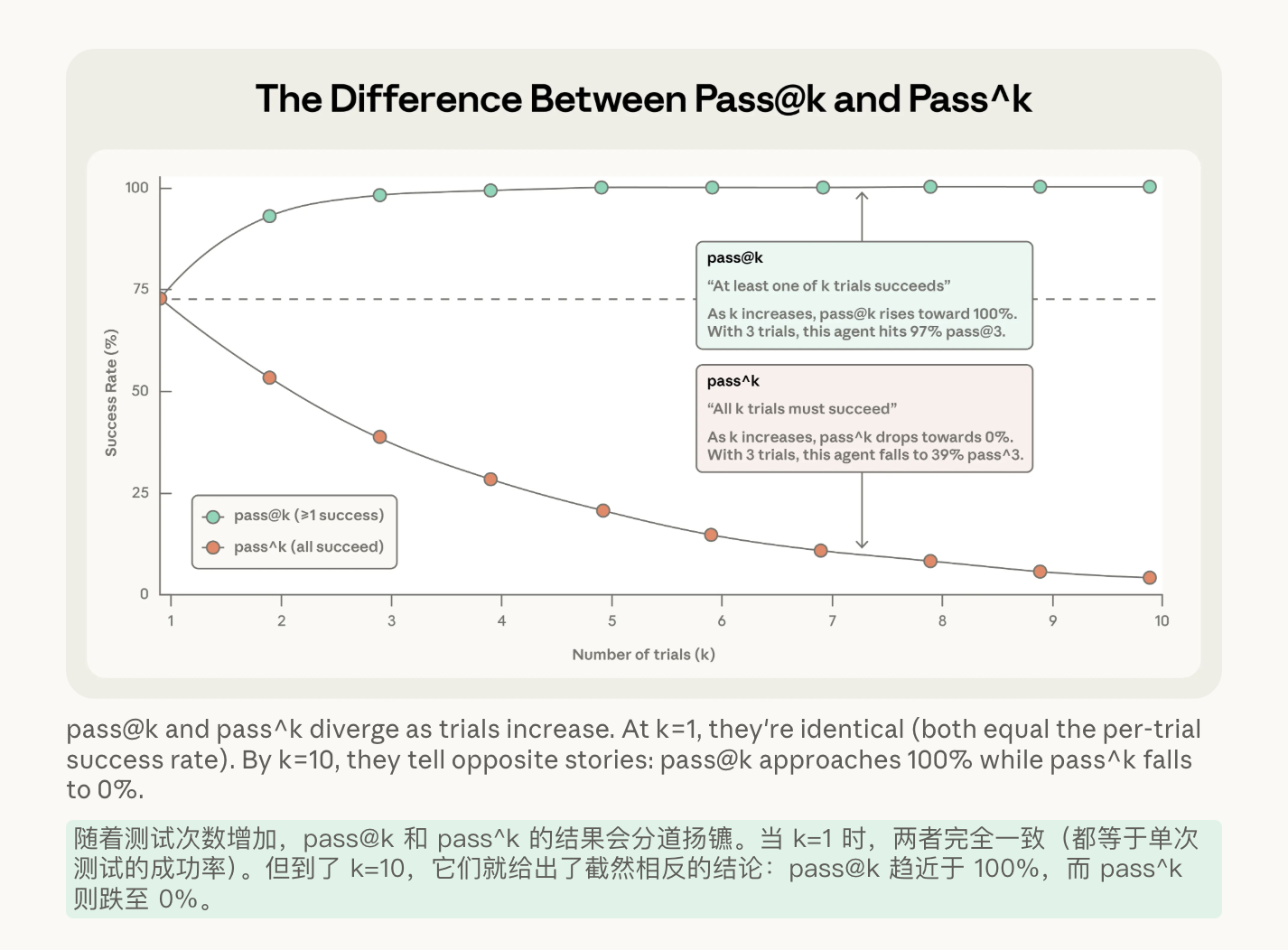

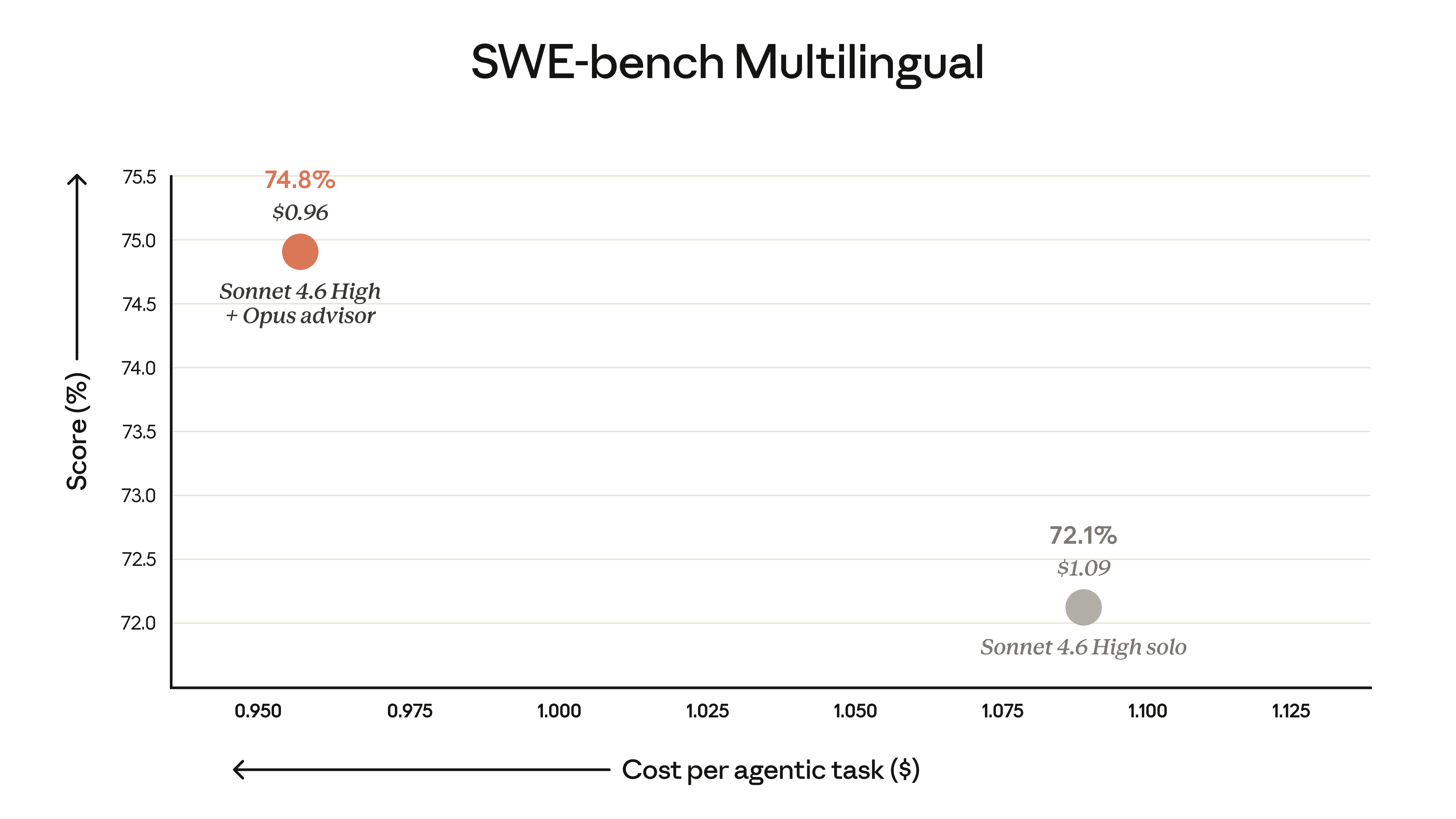

官方跑分数据很亮眼。Sonnet + Opus advisor 在 SWE-bench Multilingual 上比 Sonnet 单独跑高了 2.7pp,成本反而降了 11.9%。Haiku + Opus 更夸张,BrowseComp 从 19.7% 飙到 41.2%,成本比 Sonnet 单独跑还低 85%。

激活的方式很简单:

1 | response = client.messages.create( |

你往 Claude 模型 API 的 tools 数组里加一个 advisor_20260301,完事。整个过程在单次 API 调用内完成,不需要额外的编排层,不需要你自己管理上下文传递。

听起来很美对吧?

但仔细想想,似乎有个被忽略的关键问题:Sonnet 怎么知道什么时候该请教 Opus?

毕竟,熊将之所以熊,就是熊在盲目做决策上,如果有「自知之明」肯请教军师,那还能熊哪去?

反套路的编排模式

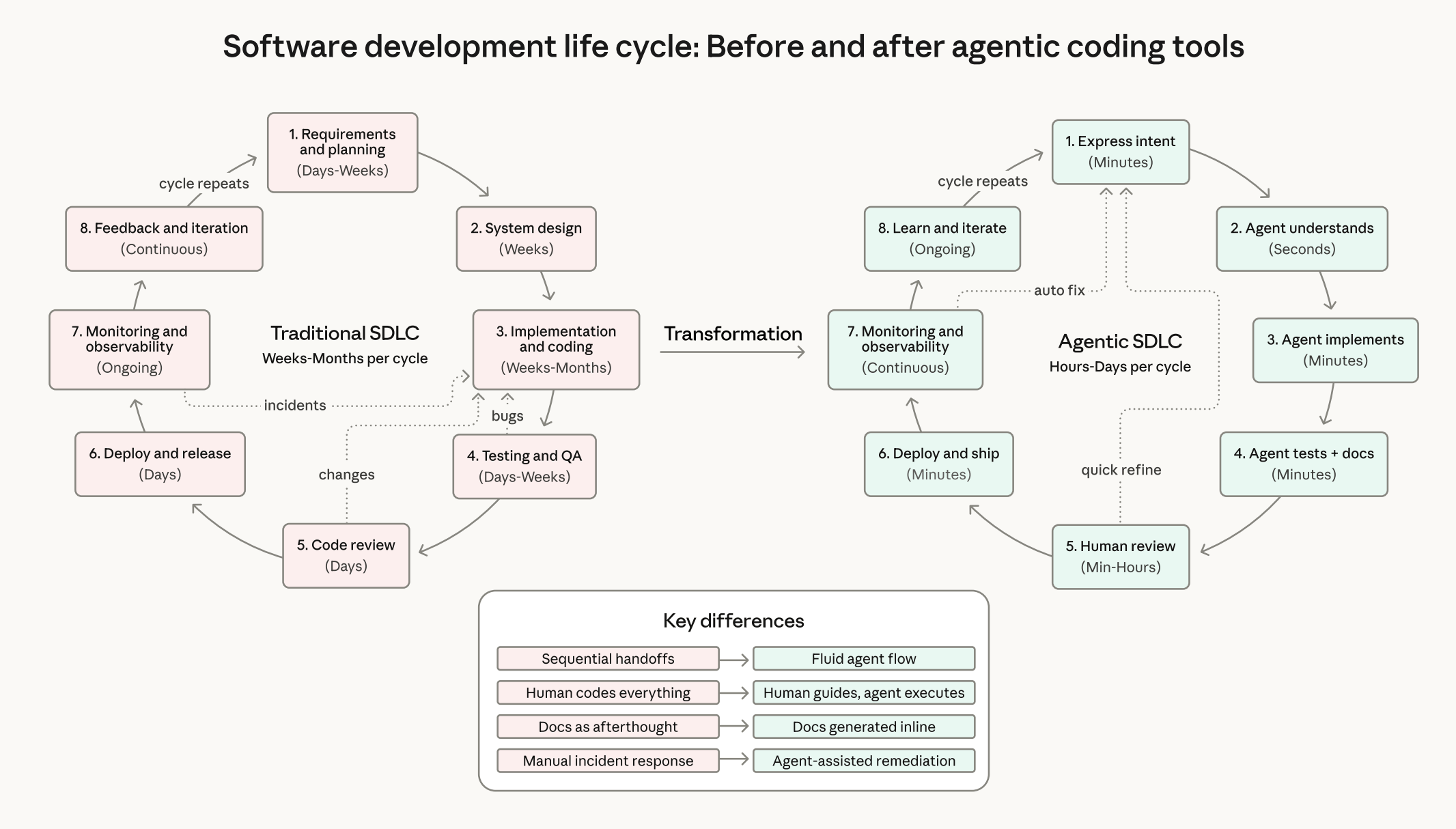

Multi-Agent 编排大家天然都是用强的lead弱模型:强模型(Opus)当指挥官,做plan、拆任务,分给小模型(Sonnet/Haiku)去执行。

但这个 Advisor Strategy 把逻辑翻转了:轮到弱模型当carry全程输出,强模型只当辅助。

Sonnet 自己决定调工具、写代码、迭代循环,95% 的工作量都在 Sonnet 完成。只有当 Sonnet 遇到它自己判断搞不定的决策时,才在服务端内部触发一次 Opus 推理,拿到 400-700 tokens 的建议,然后继续。

但这里有个隐含假设:

Sonnet 能准确判断”这个任务我搞不定”。

但这个判断题本身就是个很难的题目,好比你判断自己不知道什么,这比”知道自己知道”难多了。这就是所谓的 meta-cognition(元认知)——一个模型对自身能力边界的感知。